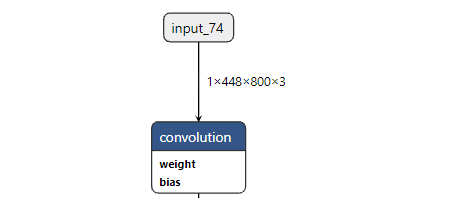

onnx模型。是pytorch训练导出的onnx模型。输入输出都是nchw格式。c通道数,h高,w宽。

提取出的json模型:

链接:百度网盘 请输入提取码

提取码:eulf

期望:

推理时,推理框架对我输入的数据不做任何修改(即reorder channel等)。输出也是我模型的原输出。

我目前的做法:

量化时:

$tensorzone

–action quantization

–source text

–source-file ./data/nuscenes_validation_tf.txt

–channel-mean-value ‘0 0 0 1’

–model-input ${NAME}.json

–model-data ${NAME}.data

–quantized-dtype asymmetric_quantized-u8

–quantized-rebuild

转case时

$export_ovxlib

–model-input ${NAME}.json

–data-input ${NAME}.data

–reorder-channel ‘0 1 2’

–channel-mean-value ‘0 0 0 1’

–export-dtype quantized

–model-quantize ${NAME}.quantize

–optimize VIPNANOQI_PID0X88

–viv-sdk …/bin/vcmdtools

–pack-nbg-unify

config.modelType = ONNX;

config.nbgType = NN_NBG_MEMORY;

config.length = size;

fclose(fp);

config.typeSize = sizeof(aml_config);

context = aml_module_create(&config);

if (context == NULL) {

return -1;

}

nn_input inData;

inData.input_index = 0; //this value is index of input,begin from 0

inData.size = img_size;

inData.input = (unsigned char*)image_data;

inData.input_type = BINARY_RAW_DATA;

ret = aml_module_input_set(context, &inData);

但

printf(“the input[0] sizes_of_dim:%d,%d,%d,%d\n”,inptr->info[0].sizes_of_dim[0], inptr->info[0].sizes_of_dim[1],inptr->info[0].sizes_of_dim[2],inptr->info[0].sizes_of_dim[3]);

输出为:

the input[0] sizes_of_dim:800,448,3,1

printf("the output[0] sizes_of_dim:%d,%d,%d,%d\n", outptr->info[0].sizes_of_dim[0], outptr->info[0].sizes_of_dim[1],outptr->info[0].sizes_of_dim[2],outptr->info[0].sizes_of_dim[3]);

输出为:

the output[0] sizes_of_dim:200,112,10,1

原onnx模型的

输入为:1,3,448,800

输入为:1,10,112,200

目测从graph拿到的输入输出 dim size 跟我期望的刚好相反。

求解决方法。